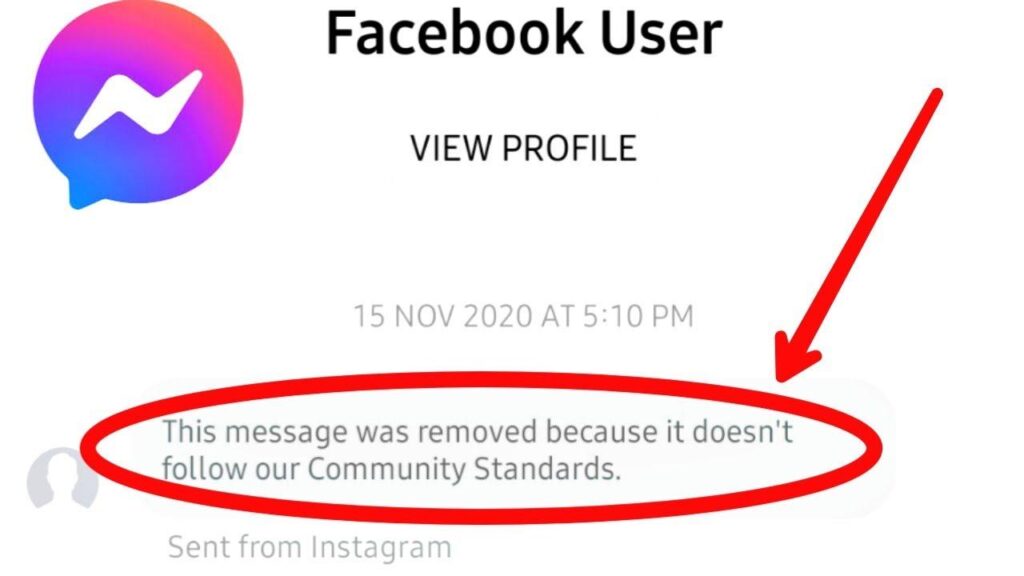

La información y las ideas se comparten libremente en todo el mundo con la vasta expansión de Internet hoy en día. Sin embargo, las plataformas de redes sociales como Facebook han establecido sus estándares comunitarios para garantizar la seguridad y el respeto de todos. A veces, puedes ver un mensaje que dice: “Este mensaje fue eliminado porque no sigue los estándares de la comunidad” y confundirte con su razón.

En este artículo, explicaremos detalladamente el significado de este mensaje para que conozcas sus causas y consecuencias. También exploraremos cómo Facebook controla el contenido para garantizar un entorno en línea seguro.

¿Puede Facebook Escanear Nuestros Mensajes para Identificar Violaciones de los Estándares Comunitarios?

Facebook afirma que escanea nuestros mensajes en su aplicación de chat para detectar y bloquear contenido que viole sus estándares comunitarios. La empresa utiliza sistemas automatizados para detectar contenido malicioso como pornografía infantil o cualquier mensaje o imagen que no cumpla con sus criterios. Una vez que las herramientas automatizadas detectan y señalan una conversación, los moderadores humanos revisan el procedimiento.

Los usuarios no deben preocuparse por su privacidad, ya que Facebook enfatiza su compromiso con la política de usuario y ofrece opciones de cifrado para Messenger y WhatsApp. Al mejorar los estándares comunitarios, Facebook busca hacer que su política de privacidad sea más amigable para el usuario.

¿Qué Tipo de Contenido Puede Ir en Contra de los Estándares Comunitarios de Facebook?

Facebook tiene políticas comunitarias específicas, y la comunidad de Facebook señalará tus mensajes si violas alguna política o ley. El mensaje “Este mensaje fue eliminado porque no sigue los estándares comunitarios” solo aparece en los siguientes casos:

- Discurso de Odio: Los mensajes que contienen discurso de odio y lenguaje ofensivo pueden ser señalados por la comunidad de Facebook. Si el discurso de odio se dirige a cualquier individuo o grupo basado en factores como raza, identidad, género o discapacidad, Facebook los elimina.

- Imágenes Violentas: Mensajes que promuevan clips horribles y videos de autolesiones también están en contra de los estándares de la comunidad de Facebook. Este tipo de videos dañinos pueden causar pánico y difundir ideas perturbadoras en la audiencia, y también son eliminados por Facebook.

- Problemas de Acoso: El estándar comunitario de Facebook rastrea mensajes que contienen acoso, tanto verbal como sexual. Además, la comunidad de Facebook no tolera el ciberacoso, ya que crea un entorno dañino e inseguro.

- Casos de Estafa y Fraude: Muchas personas estafan a otros en línea a través de SMS, anuncios o enlaces. Estas actividades fraudulentas son eliminadas o reportadas por la comunidad de Facebook para proteger a los usuarios de posibles pérdidas financieras.

- Información Engañosa: Los usuarios de medios difunden gran cantidad de información engañosa o noticias falsas en Facebook. Esto puede generar teorías de conspiración que causen pánico en el mundo real o dañen a otros. Por lo tanto, Facebook elimina estos mensajes para evitar la difusión de desinformación.

- Mensajes Amenazantes: Los usuarios también reciben mensajes que contienen amenazas. Esto puede incluir mensajes sobre actividades ilegales, violencia o chantaje, y son eliminados por la comunidad de Facebook para mantener un entorno seguro.

- Contenido Inapropiado: Las personas también reciben mensajes con contenido inapropiado, como desnudos y pornografía. Estos mensajes están estrictamente prohibidos por la comunidad de Facebook y son eliminados de inmediato.

¿Qué Sucede Cuando Facebook Elimina Mi Contenido?

Cuando Facebook elimina tu contenido, te informa inmediatamente sobre la publicación que violó sus estándares comunitarios. Normalmente, esto aparece automáticamente en tu feed cuando inicias sesión después de la eliminación del contenido, pero también puedes encontrarlo en cualquier momento en tu “Bandeja de Entrada de Soporte”. Facebook proporciona una breve descripción de la razón de la eliminación y exactamente qué parte de los estándares comunitarios no seguiste, permitiéndote evitarlo en el futuro.

Tu cuenta puede ser restringida o deshabilitada, dependiendo de la política que violaste, tu historial previo y el número de infracciones que has tenido por tales actividades. Sin embargo, si crees que tu contenido o cuenta fue eliminada sin ninguna violación, siempre puedes presentar una queja.

¿Cómo Puedes Quejarte Cuando Facebook Messenger Elimina Tu Mensaje?

Los sistemas automatizados de Facebook ocultan o eliminan el contenido cuando detectan una violación de los estándares comunitarios en tu cuenta. No obstante, siempre existe la posibilidad de errores en este sistema de detección.

Si crees que tu contenido fue eliminado sin razón, puedes solicitar una revisión, y los moderadores humanos examinarán cuidadosamente el asunto y tomarán una decisión. Tu contenido o cuenta será restaurado si fue eliminado por error.

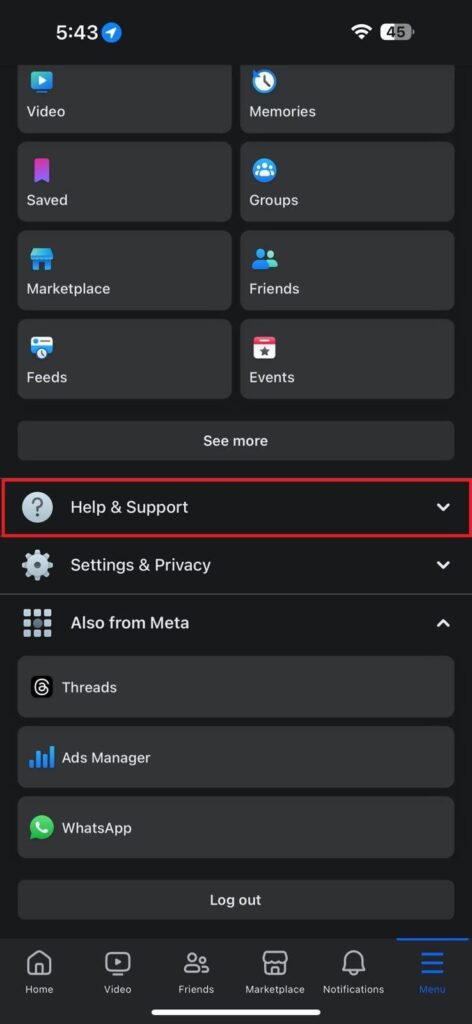

Paso 1: Para presentar una queja, primero ve a la pestaña “Menú” en la aplicación de Facebook. Luego, desplázate hacia abajo y toca “Ayuda y Soporte” para que aparezca una lista de opciones.

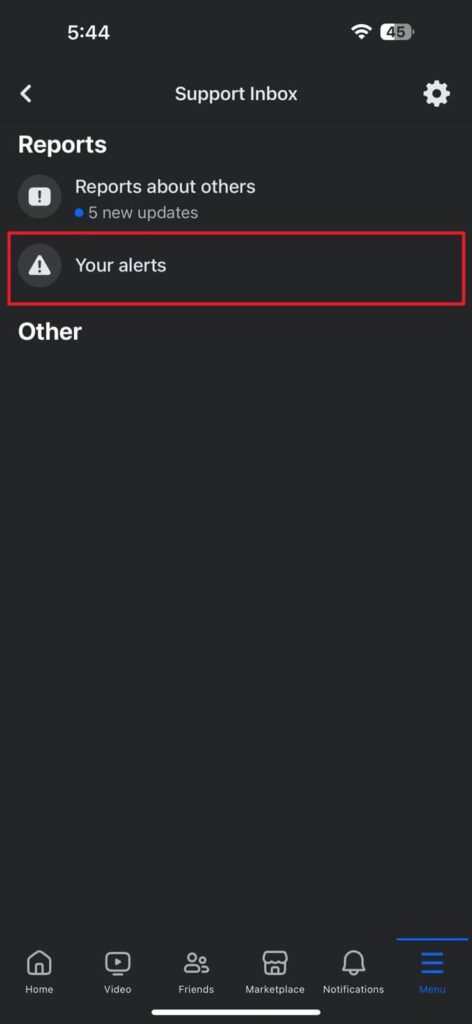

Paso 2: Luego, toca “Bandeja de Entrada de Soporte” y espera a que cargue la ventana de “Reportes”. Finalmente, abre los mensajes de “Tus Alertas”, elige los mensajes requeridos y toca “Discrepar con la Decisión”. Después de revisar tu queja, recibirás una notificación sobre los resultados y si tu contenido será restaurado o no.

Preguntas frecuentes sobre los Estándares de la Comunidad de Facebook

P1. ¿Cómo aplica Facebook sus Estándares de la Comunidad?

Facebook aplica sus Estándares de la Comunidad utilizando sistemas automáticos y revisores humanos. Estos sistemas emplean aprendizaje automático de IA para identificar y eliminar cualquier contenido que infrinja los Estándares de la Comunidad de Facebook. Además, los revisores humanos se encargan de los casos más complejos de informes, advertencias, apelaciones de revisión y suspensiones de cuentas.

P2. ¿Pueden los usuarios apelar decisiones relacionadas con la eliminación de contenido?

Sí, los usuarios pueden apelar fácilmente las decisiones relacionadas con la eliminación de contenido en Facebook. Pueden presentar una solicitud en Facebook si alguno de sus mensajes viola los Estándares de la Comunidad. Además, los usuarios pueden proporcionar razones o contexto adicional a la comunidad de Facebook. De esta manera, podrían considerar reevaluar su decisión y notificarte sobre el resultado.

P3. ¿Facebook monitorea el contenido automáticamente o manualmente?

La comunidad de Facebook utiliza una combinación de sistemas automatizados y revisiones humanas para aplicar sus Estándares de la Comunidad. El sistema identifica contenido violento y lo elimina de la página, mientras que los revisores humanos evalúan casos más complejos. Estos casos incluyen la eliminación de contenido amenazante, ofensivo, inapropiado y otros contenidos de Facebook.

P4. ¿Qué debo hacer si recibo mensajes abusivos en Facebook?

El primer paso que debes tomar al recibir un mensaje de acoso es reportarlo en Facebook. Facebook toma medidas inmediatas contra ese mensaje y lo rastrea. Además, los usuarios también pueden bloquear a la persona que envió el mensaje para evitar más contacto con esa persona. Estas dos medidas pueden ayudarte a no recibir mensajes no deseados y abusivos.

Conclusión

En conclusión, este mensaje sirve como un recordatorio vital de las reglas y regulaciones establecidas por Facebook para mantener un entorno en línea respetuoso. Los usuarios deben ser conscientes de sus derechos para apelar decisiones de eliminación de contenido y buscar la reinstalación si creen que su contenido fue eliminado injustamente. Como se explicó a lo largo del artículo, este complejo sistema de moderación de contenido tiene como objetivo encontrar un equilibrio entre preservar la libertad de expresión y mantener una comunidad en línea segura.